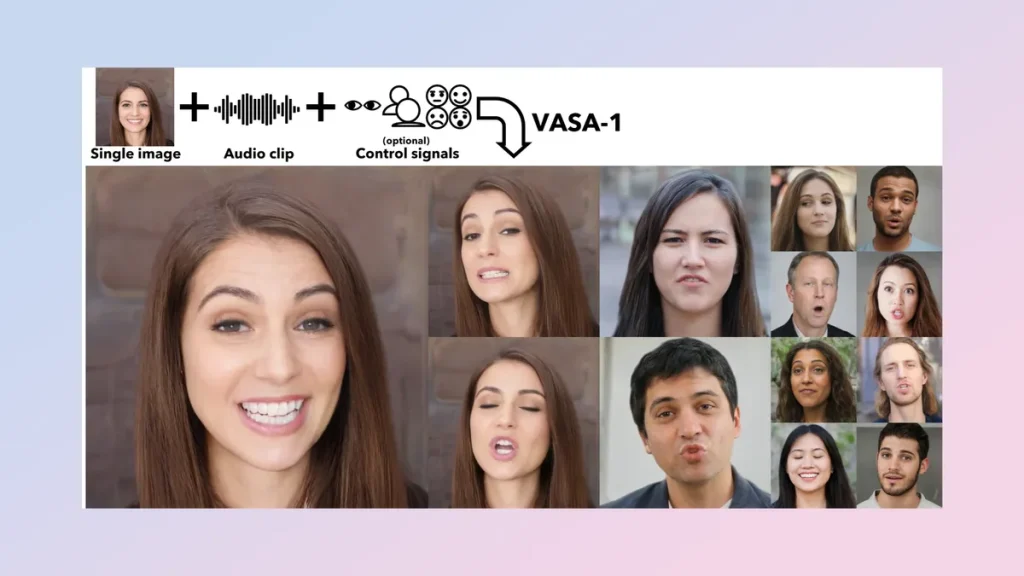

Un nuovo documento di ricerca AI di Microsoft promette un futuro in cui è possibile caricare una foto, un campione della vostra voce e creare un live, animato parlando testa del proprio volto.

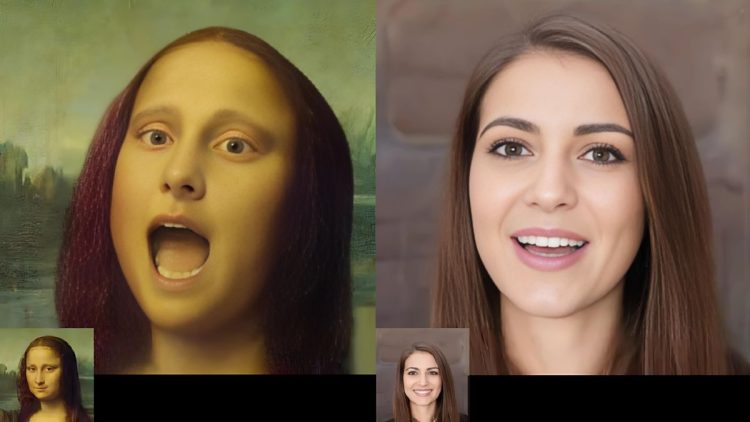

VASA-1 prende in una singola foto ritratto e un file audio e lo converte in un video iperrealistico faccia parlante completo di sincronizzazione delle labbra, caratteristiche facciali realistiche e movimento della testa.

Il modello è attualmente solo un’anteprima di ricerca e non disponibile per chiunque al di fuori del team di Microsoft Research da provare, ma i video demo sembrano impressionanti.

La tecnologia di sincronizzazione delle labbra e movimento della testa è già disponibile da Runway e Nvidia, ma questo sembra essere di una qualità molto superiore e realismo, riducendo artefatti bocca. Questo approccio all’animazione audio-driven è anche simile a un recente modello VLOGGER AI di Google Research.

Come funziona VASA-1?

Microsoft dice che questo è un nuovo quadro per la creazione di volti parlanti realistici e specificamente allo scopo di animare personaggi virtuali. Tutte le persone negli esempi erano sintetici, realizzati utilizzando DALL-E, ma se può animare un’immagine realistica AI, può animare una foto reale.

Nella demo vediamo le persone parlare come se fossero state filmate, con un movimento leggermente a scatti ma altrimenti naturale. La sincronizzazione delle labbra è molto impressionante, con movimento naturale e nessun artefatto intorno alla parte superiore e inferiore della bocca visto in altri strumenti.

Una delle cose più impressionanti di VASA-1 sembra essere il fatto che non richiede un’immagine in stile ritratto a faccia in avanti per farlo funzionare.

Ci sono esempi con scatti rivolti verso una serie di direzioni. Il modello sembra anche avere un alto grado di controllo, in grado di prendere la direzione dello sguardo, la distanza della testa e anche l’emozione come input per guidare la generazione.

Qual è il punto di VASA-1?

Uno dei casi d’uso più evidenti per questo è nella sincronizzazione delle labbra avanzata per i giochi. Essere in grado di creare NPC AI-driven con movimento naturale labbro potrebbe essere un punto di svolta per l’immersione.

Potrebbe anche essere utilizzato per creare avatar virtuali per i video di social media, come già visto da aziende come Heygen e Synthesia. Un’altra area è in AI-based film making. Si potrebbe fare un video musicale più realistico se si può avere un cantante AI che sembra che stanno cantando.

Detto questo, il team dice che questa è solo una dimostrazione di ricerca, senza piani per un rilascio pubblico o anche rendendolo disponibile per gli sviluppatori da utilizzare nei prodotti.

Microsoft Research Asia

Quanto bene funziona VASA-1?

Una cosa che ha sorpreso i ricercatori è stata la capacità di VASA-1 di sincronizzare perfettamente le labbra a una canzone, riflettendo le parole del cantante senza problemi nonostante nessuna musica utilizzata nel set di dati di allenamento. Ha anche gestito diversi stili di immagine tra cui la Monna Lisa.

Hanno ottenuto la creazione di 512×512 pixel immagini a 45 fotogrammi al secondo e può farlo in circa 2 minuti utilizzando un desktop-grade Nvidia RTX 4090 GPU.

Mentre dicono che questo è solo per la ricerca, sarà un peccato se questo non uscire nel pubblico dominio, anche se solo per gli sviluppatori come mi piacerebbe vederlo in Runway o Pika Labs. Dato Microsoft ha una partecipazione enorme in OpenAI questo potrebbe anche essere parte di una futura integrazione Copilot Sora.

Maestro del Caos Digitale e Guardiano del Cyberspazio, naviga nel mare oscuro della sicurezza informatica da oltre vent’anni, armato di codice e un irresistibile papillon.

Con la precisione di un bisturi e l’umorismo di un hacker, ha trasformato centinaia di “comuni mortali IT” in veri e propri ninja dell’Ethical Hacking. La sua missione? Insegnare l’arte della difesa digitale a migliaia di ignare risorse aziendali, un firewall alla volta.

Tre segreti che lo rendono un unicorno nel mondo cyber:

Ha una relazione quasi ossessiva con le password. Alcuni collezionano francobolli, lui colleziona hash crittografici.

Il suo gatto si chiama Hash. Sì, come l’algoritmo. No, non miagola in binario (ancora).

Indossa sempre un papillon, perché chi ha detto che non si può hackerare con stile?

Se lo cercate, seguite la scia di bit verdi: è il suo colore preferito. Perché anche nel mondo digitale, è sempre primavera per la sicurezza!